สงครามที่ AI ถือไกปืน

เมื่อวันที่ 7 ตุลาคม ค.ศ. 2023 กลุ่มฮามาส (Hamas) โจมตีอิสราเอลด้วยกำลังพลและอาวุธนับพัน เหตุการณ์ดังกล่าวจุดชนวนสงครามในกาซา (Gaza) ที่ยาวนานและรุนแรงที่สุดในรอบหลายทศวรรษ แต่สิ่งที่นักวิชาการด้านความมั่นคงระหว่างประเทศให้ความสนใจเป็นพิเศษไม่ใช่ตัวเลขผู้เสียชีวิตหรือพื้นที่ดินที่เปลี่ยนมือ หากแต่เป็น “วิธีการ” ที่กองทัพอิสราเอลใช้ในการเลือกเป้าหมายโจมตี ซึ่งรายงานจาก +972 Magazine และ Local Call ที่ตีพิมพ์ในเดือนเมษายน ค.ศ. 2024 ได้เปิดเผยถึงระบบ AI ที่เรียกว่า ลาเวนเดอร์ (Lavender) ซึ่งถูกใช้เพื่อคัดกรองและจัดอันดับเป้าหมายบุคคลที่ต้องสังหาร1

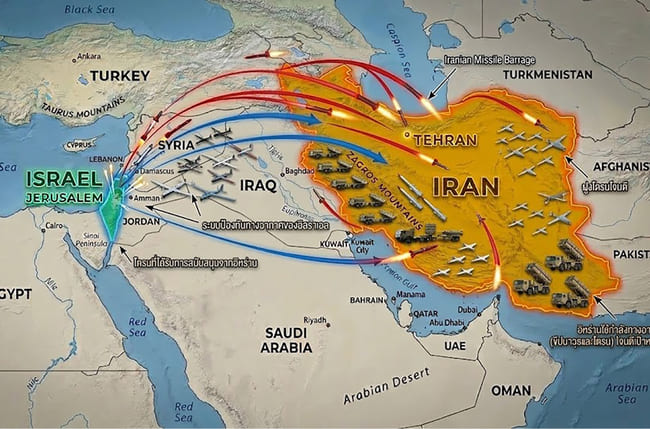

ในเวลาเดียวกัน ความขัดแย้งในระดับภูมิภาคระหว่างอิสราเอลและอิหร่านก็ขยายตัวออกไป ผ่านการโจมตีทางอากาศโดยตรง การใช้กองกำลังตัวแทน (Proxy Forces) อย่างฮิสดุลลาห์ (Hezbollah) ในเลบานอน ฮูติ (Houthi) ในเยเมน และกลุ่มติดอาวุธต่างๆ ในซีเรีย และอิรัก แต่ละฝ่ายล้วนใช้โดรนอัจฉริยะ ขีปนาวุธนำวิถีด้วย AI และระบบตอบโต้อัตโนมัติในระดับที่ไม่เคยปรากฏมาก่อน ทำให้นักกฎหมายระหว่างประเทศ นักปรัชญาด้านจริยธรรม และนักวิทยาศาสตร์คอมพิวเตอร์ต้องหันมาร่วมถกเถียงคำถามเดียวกันว่า: “ใครหรืออะไรที่รับผิดชอบทางศีลธรรมเมื่อ AI เป็นผู้ตัดสินใจสังหาร?”

ลาเวนเดอร์ ระบบ AI ของกองทัพอิสราเอล สามารถสร้างรายชื่อเป้าหมายสังหารได้มากกว่า 37,000 ราย ภายในไม่กี่สัปดาห์แรกของสงครามกาซา— ด้วยกระบวนการที่เจ้าหน้าที่ใช้เวลาตรวจสอบเฉลี่ยเพียง 20 วินาทีต่อราย1

กายวิภาคของอาวุธอัตโนมัติ : AI ตัดสินใจอย่างไร

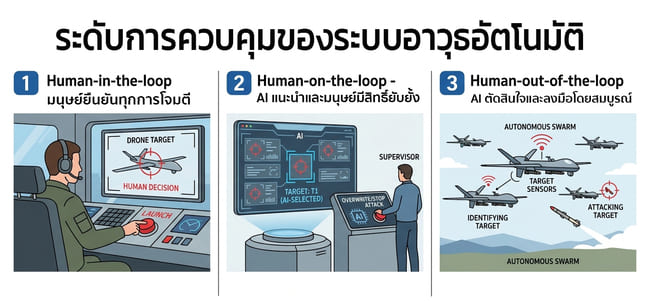

เพื่อทำความเข้าใจปัญหาเชิงจริยธรรมที่แท้จริง จำเป็นต้องเข้าใจกลไกการทำงานของระบบอาวุธอัตโนมัติสังหาร – LAWS (Lethal Autonomous Weapon Systems) ก่อน นักวิชาการอย่าง Paul Scharre จาก Center for a New American Security แบ่งระดับความเป็นอัตโนมัติออกเป็นสามชั้น ได้แก่ (1) Human-in-the-loop ซึ่งมนุษย์ยืนยันทุกการโจมตี (2) Human-on-the-loop ซึ่ง AI แนะนำและมนุษย์มีสิทธิ์ยับยั้ง และ (3) Human-out-of-the-loop ซึ่ง AI ตัดสินใจและลงมือโดยสมบูรณ์2 ระบบ ลาเวนเดอร์ ที่ถูกกล่าวถึงในกรณีของอิสราเอลดูเหมือนจะเคลื่อนระหว่างชั้นที่สองและสามอย่างเลื่อนไหล ขึ้นอยู่กับสถานการณ์ภาคสนาม

ลาเวนเดอร์ ถูกฝึกสอนด้วยข้อมูลของสมาชิกฮามาส และจิฮาดอิสลามปาเลสไตน์ ที่ทราบตัว โดยใช้ตัวแปรพฤติกรรมหลายสิบรายการ เช่น รูปแบบการสื่อสาร การเข้าร่วมกลุ่ม และรหัสโทรศัพท์ เพื่อคาดการณ์ความน่าจะเป็นว่าบุคคลใดเป็น “นักรบ” ระบบดังกล่าวอ้างอิงผลลัพธ์ด้วยค่าความน่าเชื่อถือ (Confidence Score) ตั้งแต่ 1 ถึง 100 และทหารได้รับคำสั่งให้อนุมัติการโจมตีผู้ที่ได้คะแนน 90 ขึ้นไปด้วยการตรวจสอบของมนุษย์ที่สั้นมาก1 ระบบนี้จึงสร้างคำถามที่ยากมาก: “เมื่อเครื่องจักรบอกว่าบุคคลนี้น่าจะเป็นนักรบถึง 90% และเสียชีวิตจากการโจมตี สิ่งที่เกิดขึ้นกับ 10% ที่เหลือถือว่าเป็นการสังหารที่ถูกต้องตามกฎหมายหรือการสังหารโดยประมาทเลินเล่อ?”

กรณีศึกษา: ระบบกอสเพล Gospel (HaBashour) ของกองทัพอิสราเอลซึ่งทำงานควบคู่กับ ลาเวนเดอร์ ถูกออกแบบให้คัดเลือกอาคารและโครงสร้างพื้นฐานที่เชื่อมโยงกับฮามาส ขณะที่ระบบ “Where’s Daddy?” ถูกรายงานว่าใช้ติดตามเป้าหมายไปยังที่พักอาศัยส่วนตัว รายงานชี้ว่าในช่วงแรกของสงคราม ทหารได้รับอนุญาตให้ยอมรับ “ความเสียหายโดยอ้อม” (Collateral Damage) ต่อพลเรือนที่ไม่ใช่เป้าหมายได้มากถึง 15–20 คน ต่อการสังหารเป้าหมาย 1 ราย1

ในฝั่งอิหร่านและกลุ่มติดอาวุธที่ได้รับการสนับสนุน แม้จะมีเทคโนโลยีที่ด้อยกว่า แต่โดรนชนิด One-way Attack (Kamikaze Drone) อย่าง Shahed-136 ก็เป็นตัวอย่างของระบบกึ่งอัตโนมัติที่สามารถบินตามพิกัด GPS โดยไม่ต้องอาศัยการควบคุมจากนักบินตลอดเวลา3 การแพร่กระจายของเทคโนโลยีเหล่านี้ไปสู่กลุ่มฮูติ ในเยเมน และฮิสดุลลาห์ ในเลบานอน ยิ่งตอกย้ำว่าสงคราม AI ไม่ใช่อภิสิทธิ์ของชาติมหาอำนาจอีกต่อไป

กฎหมายระหว่างประเทศกับสุญญากาศทางกฎเกณฑ์

กฎหมายมนุษยธรรมระหว่างประเทศ (International Humanitarian Law: IHL) โดยเฉพาะอนุสัญญาเจนีวา (Geneva) และพิธีสาร Additional Protocol I กำหนดหลักการสำคัญสองข้อที่เกี่ยวข้องโดยตรง ได้แก่ หลักการแบ่งแยก (Distinction Principle) ที่ต้องแยกแยะนักรบออกจากพลเรือน และหลักความได้สัดส่วน (Proportionality Principle) ที่ห้ามโจมตีหากความเสียหายต่อพลเรือนเกินกว่าประโยชน์ทางการทหารที่คาดหวัง4 แต่ LAWS ก่อให้เกิดคำถามที่กฎหมายเหล่านี้ไม่ได้ออกแบบมาเพื่อตอบ

นักกฎหมาย Bonnie Docherty แห่ง Harvard Law School ชี้ว่าปัญหาหลักคือ “ช่องว่างความรับผิดชอบ” (Accountability Gap) กล่าวคือ เมื่อ AI ตัดสินใจสังหาร ความรับผิดชอบทางกฎหมายตกอยู่ที่ใคร ผู้พัฒนาระบบ? ผู้บัญชาการที่อนุมัติการใช้งาน? หรือทหารที่กดปุ่มยืนยันในเวลา 20 วินาที? กฎหมายระหว่างประเทศปัจจุบันไม่มีคำตอบที่ชัดเจน5 ขณะที่ UN Group of Governmental Experts (GGE) ยังคงถกเถียงกันมาตั้งแต่ปี ค.ศ. 2014 โดยไม่สามารถบรรลุข้อตกลงในการร่างสนธิสัญญา (Treaty) ห้าม LAWS ได้ เนื่องจากประเทศมหาอำนาจอย่างสหรัฐอเมริกา รัสเซีย และจีน ต่างปฏิเสธการผูกพันตนเองด้วยสนธิสัญญาที่มีผลผูกพัน6

มีข้อผิดพลาดที่ยอมรับไม่ได้ในการใช้ระบบ AI ตัดสินใจชีวิตมนุษย์ เนื่องจากระบบเหล่านี้ไม่มีความสามารถในการตัดสินใจทางจริยธรรม ไม่สามารถเข้าใจบริบท และไม่มีความรู้สึกรับผิดชอบ7

ในบริบทของความขัดแย้งระหว่างกาซากับอิหร่าน สุญญากาศทางกฎเกณฑ์นี้ถูกใช้ประโยชน์อย่างเต็มที่ กองทัพอิสราเอลอ้างว่าระบบ AI ช่วยลดการสูญเสียพลเรือนโดยการตัดสินใจที่แม่นยำและรวดเร็วกว่ามนุษย์ ในขณะที่นักวิจารณ์โต้แย้งว่าการใช้ระบบดังกล่าวในความเป็นจริงกลับเพิ่มจำนวนผู้เสียชีวิตที่เป็นพลเรือน เนื่องจากความเร็วในการโจมตีที่สูงขึ้นและการลดลงของการตรวจสอบจากมนุษย์1

มิติทางศาสนาและวัฒนธรรม: โลกมุสลิมกับสงคราม AI

ความขัดแย้งนี้ไม่ได้เป็นเพียงการปะทะกันของกำลังทหาร แต่ยังเป็นการปะทะกันของวาทกรรมและความหมาย ในโลกมุสลิมซึ่งประกอบด้วยกว่า 57 ประเทศและประชากรเกือบ 2 พันล้านคน การโจมตีในกาซา ถูกมองผ่านกรอบของ “การฆ่าล้างเผ่าพันธุ์” และ “สงครามครั้งใหม่ของลัทธิจักรวรรดินิยม” บทบาทของ AI ในการโจมตีทำให้ความเกลียดชังยิ่งลึกขึ้น เพราะมันสื่อนัยว่าชีวิตของมนุษย์ถูกตัดสินโดยอัลกอริทึมที่เขียนโดยฝ่ายตรงข้าม นักวิชาการด้านจริยธรรมอิสลาม เช่น Tariq Ramadan ได้เสนอว่าในกรอบของ Fiqh (นิติศาสตร์อิสลาม) การสังหารโดย AI นั้นขัดต่อหลัก “niyyah” (เจตนา) ที่เป็นองค์ประกอบสำคัญของความรับผิดชอบทางศีลธรรม เนื่องจากเครื่องจักรไม่มีเจตนา การกระทำของมันจึงไม่สามารถถูกตัดสินว่าถูกหรือผิดในแง่จริยธรรมอิสลาม แต่ความรับผิดชอบกลับโอนไปยังผู้ออกแบบและผู้ใช้งานทั้งหมด8 มุมมองนี้สร้างพื้นที่สำหรับการเรียกร้องความรับผิดชอบระหว่างประเทศในรูปแบบใหม่

ในทางกลับกัน อิหร่านเองก็ได้ลงทุนอย่างหนักในเทคโนโลยีโดรนและอาวุธนำวิถีอัจฉริยะ โดยอ้างวาทกรรม “การต่อต้านการกดขี่” (Resistance Axis) เพื่อให้ความชอบธรรมกับการใช้เทคโนโลยีเดียวกันนี้ ขณะที่กลุ่ม ฮูติ ใน เยเมน ใช้โดรนที่ได้รับการสนับสนุนจากอิหร่านโจมตีเรือสินค้าในทะเลแดง และอ้างว่าเป็นการสนับสนุนปาเสลไตน์9 สิ่งนี้แสดงให้เห็นว่าการตอบสนองต่อสงคราม AI ในโลกมุสลิมไม่ได้เป็นเอกภาพ แต่ถูกกำหนดโดยผลประโยชน์ทางการเมืองและภูมิรัฐศาสตร์ไม่น้อยไปกว่าหลักจริยธรรม

ความเสี่ยงเชิงระบบ: การแพร่กระจายและการสูญเสียการควบคุม

บทเรียนที่น่ากลัวที่สุดจากความขัดแย้งนี้อาจไม่ใช่สิ่งที่เกิดขึ้นแล้ว แต่คือสิ่งที่กำลังจะเกิดขึ้น Max Tegmark แห่ง MIT และผู้เชี่ยวชาญ AI อีกกว่าสามพันคนได้ลงนามในจดหมายเปิดผนึกเมื่อปี ค.ศ. 2023 เรียกร้องให้ระงับการพัฒนา LAWS โดยชี้ว่าเมื่อเทคโนโลยีเหล่านี้แพร่กระจายออกไป จะยากเกินการที่จะควบคุม10 ความกังวลนี้ไม่ใช่ทฤษฎีอีกต่อไป เพราะเทคโนโลยีโดรนอัจฉริยะราคาถูกที่ใช้ใน กาซา และ เยเมน ปัจจุบันสามารถสั่งซื้อได้บนอินเทอร์เน็ตและดัดแปลงให้มีความสามารถทางทหารได้ในเวลาไม่นาน

Stuart Russell นักวิทยาศาสตร์คอมพิวเตอร์แห่ง UC Berkeley เสนอภาพอนาคตที่น่าหวาดกลัวว่า เมื่อ การกำหนดเป้าโดย AI ถูกรวมเข้ากับโดรนราคาถูก กลุ่มติดอาวุธขนาดเล็กก็อาจสามารถก่อการโจมตีแบบการสังหารหมู่ ต่อเป้าหมายหลายร้อยคนพร้อมกันโดยใช้เงินเพียงไม่กี่หมื่นดอลลาร์11 การปล่อยให้สุญญากาศด้านกฎเกณฑ์ดำเนินต่อไปจึงไม่ใช่แค่ปัญหาของการสงครามระหว่างรัฐ แต่เป็นปัญหาของความปลอดภัยสาธารณะในระดับโลก

ตัวเลขที่น่าตระหนก: ตามรายงานของ Stockholm International Peace Research Institute (SIPRI) ปี ค.ศ. 2024 มีประเทศอย่างน้อย 49 ประเทศที่กำลังพัฒนาหรือซื้อระบบอาวุธที่มีระดับความเป็นอัตโนมัติบางอย่าง และมีมากกว่า 12 ประเทศในโลกมุสลิมที่อยู่ในรายชื่อนั้น รวมถึงตุรกี ซาอุดีอาระเบีย สหรัฐอาหรับเอมิเรตส์ และอิหร่าน12

ทางออก: กรอบจริยธรรมที่โลกต้องการ

แม้ภาพรวมจะดูสิ้นหวัง แต่นักวิชาการหลายท่านได้เสนอทางออกที่เป็นรูปธรรม Noel Sharkey แห่ง University of Sheffield ผู้ก่อตั้ง Campaign to Stop Killer Robots โต้แย้งว่าการห้ามโดยเด็ดขาด (Outright Ban) เป็นเป้าหมายที่ทำได้จริงและเป็นบรรทัดฐานเดียวกับที่โลกใช้กับอาวุธเคมีและทุ่นระเบิดสังหารบุคคล13 ขณะที่ Kenneth Payne นักวิชาการด้าน Strategic Studies จาก King’s College London เสนอว่าแทนที่จะห้ามสมบูรณ์ โลกควรกำหนดมาตรฐานขั้นต่ำ เช่น บังคับให้ต้องมีมนุษย์อนุมัติการโจมตีทุกครั้ง และกำหนดระยะเวลาขั้นต่ำในการตรวจสอบ14

ในระดับเทคนิค นักวิจัย AI อย่าง Yoshua Bengio ผู้ได้รับรางวัล Turing Award ได้เรียกร้องให้บริษัทเทคโนโลยีปฏิเสธสัญญาทางทหารที่เกี่ยวข้องกับระบบสังหารอัตโนมัติ และเสนอ “การตรวจสอบอิสระ” (Independent Audit) ของระบบ AI ที่ใช้ในสงครามก่อนการนำไปใช้งานจริง15 ข้อเสนอเหล่านี้สอดคล้องกับ EU AI Act ที่จัดให้ระบบ AI ในบริบทความมั่นคงอยู่ในหมวด “ความเสี่ยงสูงที่สุด” และต้องผ่านการประเมินก่อนใช้งาน แม้ว่าระบบทางทหารจะถูกยกเว้นจาก Act นี้อยู่บางส่วน16

บทสรุป: คำถามที่มนุษยชาติยังไม่มีคำตอบ

ความขัดแย้งระหว่างอิสราเอล กาซา อิหร่าน และโลกมุสลิมในยุคปัจจุบัน ได้พาโลกเข้าสู่อาณาเขตใหม่ที่กฎหมาย จริยธรรม และเทคโนโลยียังตามไม่ทัน เราอยู่ในช่วงเวลาที่เครื่องจักรตัดสินชีวิตคนจริง ๆ แต่มนุษย์ยังไม่ได้ตัดสินใจว่าจะให้เครื่องจักรทำเช่นนั้นได้หรือไม่

คำถามสำคัญที่บทความนี้ทิ้งไว้ให้ไม่ได้มีคำตอบที่ง่าย แต่ต้องการการตอบอย่างเร่งด่วน: หากระบบ AI ระบุเป้าหมายผิดและสังหารพลเรือน ใครคือผู้รับผิดชอบ? กฎหมายระหว่างประเทศที่มีอยู่สามารถบังคับใช้กับผู้พัฒนา AI ในรัฐบาลที่ไม่ให้ความร่วมมือได้หรือไม่? และในโลกที่ทั้งฝ่ายอิสราเอลและฝ่ายอิหร่านต่างอ้างความชอบธรรมในการใช้ AI เพื่อ “ปกป้อง” ประชาชนของตน เราจะหาจุดกึ่งกลางที่ยอมรับได้ทางศีลธรรมได้อย่างไร?

สิ่งที่ชัดเจนคือ เทคโนโลยีไม่รอคำตอบ ขณะที่นักวิชาการยังถกเถียง ระบบ AI ทางการทหารกำลังถูกพัฒนา ทดสอบ และนำไปใช้จริงในสนามรบจริงกับชีวิตคนจริง ความล่าช้าในการสร้างกรอบกฎเกณฑ์ระหว่างประเทศไม่ได้หมายความว่าโลกยังปลอดภัย มันหมายความว่าโลกกำลังแล่นไปข้างหน้าโดยไม่มีเบรก

เขียนโดย

ศูนย์วิชาการด้านการรู้เท่าทันสื่อของผู้สูงอายุ (ICEM)

รายการอ้างอิง

- Abraham, Y., Cohen, Y., & Kubovich, Y. (2024, April 3). “Lavender”: The AI machine directing Israel’s bombing spree in Gaza. +972 Magazine & Local Call. https://www.972mag.com/lavender-ai-israeli-army-gaza/

- Scharre, P. (2018). Army of None: Autonomous Weapons and the Future of War. W. W. Norton & Company. New York.

- Fabian, E. (2022, November 8). Iran’s Shahed-136: How does it work and why is it effective? The Times of Israel. https://www.timesofisrael.com

- International Committee of the Red Cross. (1977). Protocol Additional to the Geneva Conventions of 12 August 1949 (Protocol I). ICRC. Geneva.

- Docherty, B. (2012). Losing Humanity: The Case against Killer Robots. Human Rights Watch & IHRC. https://www.hrw.org/report/2012/11/19/losing-humanity/case-against-killer-robots

- UN Group of Governmental Experts on LAWS. (2023). Report of the 2023 session of the Group of Governmental Experts on Lethal Autonomous Weapons Systems. UN Document CCW/GGE.1/2023/3.

- UN Special Rapporteur on Extrajudicial Executions. (2021). Report on lethal autonomous weapons systems. UN General Assembly Document A/HRC/47/34.

- Ramadan, T. (2009). Radical Reform: Islamic Ethics and Liberation. Oxford University Press. Oxford.

- Jones, C., & Tabrizi, A. B. (2024). Iran’s Military Use of Drones and the Houthi Threat in the Red Sea. Royal United Services Institute (RUSI). London. https://rusi.org

- Future of Life Institute. (2023). Autonomous Weapons Open Letter. https://futureoflife.org/open-letter/autonomous-weapons-open-letter-2023/

- Russell, S. (2019). Human Compatible: Artificial Intelligence and the Problem of Control. Viking Press. New York.

- Stockholm International Peace Research Institute (SIPRI). (2024). Autonomy in Weapons Systems: Trends, Developments and Key Issues. SIPRI Yearbook 2024. Oxford University Press.

- Campaign to Stop Killer Robots. (2024). Country Views on Killer Robots 2024. https://www.stopkillerrobots.org/research/country-views-2024/

- Payne, K. (2021). I, Warbot: The Dawn of Artificially Intelligent Conflict. Hurst Publishers. London.

- Bengio, Y., Russell, S., & Hinton, G. (2023). Statement on AI Risk. Center for AI Safety. https://www.safe.ai/statement-on-ai-risk

- European Parliament & Council of the European Union. (2024). Regulation (EU) 2024/1689 on Artificial Intelligence (AI Act). Official Journal of the European Union. Brussels.